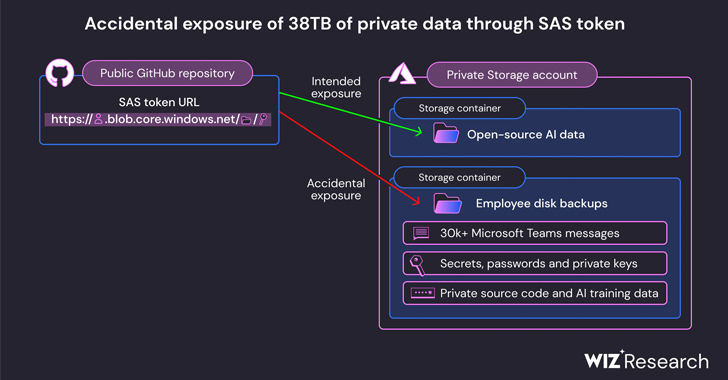

Microsoft a annoncé lundi avoir pris des mesures pour corriger une faille de sécurité flagrante qui exposait 38 téraoctets de données privées.

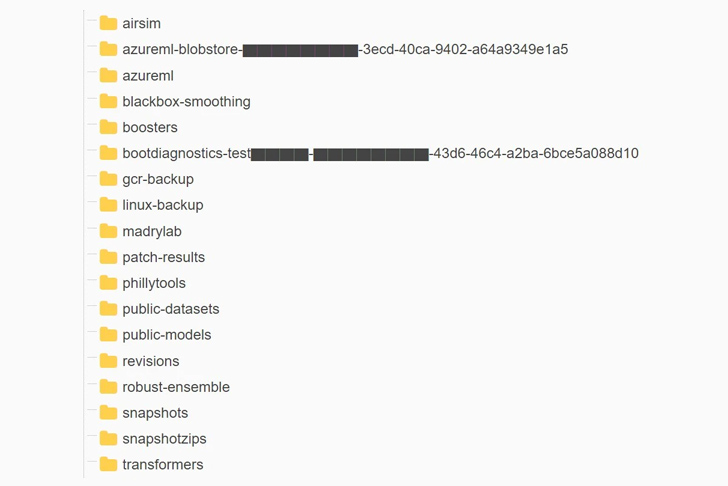

La fuite a été découverte dans le référentiel AI GitHub de l’entreprise et aurait été rendue publique par inadvertance lors de la publication d’un ensemble de données de formation open source, a déclaré Weese. Il comprend également une sauvegarde sur disque de deux postes de travail d’anciens employés contenant des secrets, des clés, des mots de passe et plus de 30 000 messages internes aux équipes.

L’entrepôt nommé « Transférez des modèles puissants« , n’est plus disponible. Avant sa suppression, il incluait le code source et les modèles d’apprentissage automatique liés à Document de recherche 2020 Titré « Les modèles ImageNet robustes transfèrent-ils mieux ?

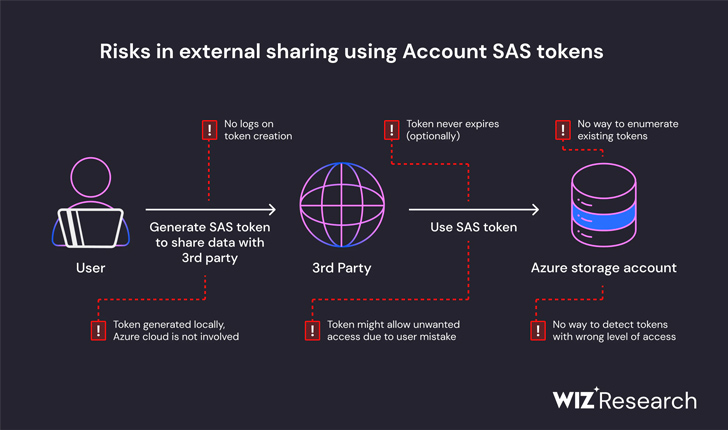

« Cette exposition est le résultat d’une indulgence excessive Code SAS « Une fonctionnalité Azure qui permet aux utilisateurs de partager des données d’une manière difficile à suivre et à invalider », Wiz Il a dit Dans un rapport. Le problème a été signalé à Microsoft le 22 juin 2023.

Plus précisément, le fichier README.md du référentiel demandait aux développeurs de télécharger des modèles à partir d’une URL de stockage Azure qui accordait également par erreur l’accès à l’intégralité du compte de stockage, exposant ainsi des données privées supplémentaires.

« En plus de l’étendue de l’accès trop permissive, le code a également été mal configuré pour permettre des autorisations de « contrôle total » au lieu d’une simple lecture », ont déclaré Hilay Ben-Sasson et Ronnie Greenberg, chercheurs de Waze. « C’est-à-dire qu’un attaquant peut non seulement afficher tous les fichiers du compte de stockage, mais également supprimer et écraser les fichiers existants. »

En réponse aux résultats, Microsoft Il a dit Son enquête n’a trouvé aucune preuve de divulgation non autorisée des données des clients et « aucun autre service interne n’a été compromis par ce problème ». Elle a également souligné que les clients n’ont aucune démarche à entreprendre de leur part.

Les fabricants de Windows ont également indiqué qu’ils avaient révoqué le jeton SAS et bloqué tout accès externe au compte de stockage. Le problème a été résolu deux jours après la détection officielle.

Pour atténuer ce risque à l’avenir, la société a étendu son service d’analyse confidentielle pour inclure tout code SAS pouvant avoir des délais d’expiration ou des privilèges excessifs. Il a déclaré avoir également identifié un bug dans son système d’analyse qui signalait l’URL SAS spécifique dans le référentiel comme un faux positif.

« En raison du manque de sécurité et de gouvernance des jetons de compte SAS, ils devraient être considérés comme aussi sensibles que la clé de compte elle-même », ont déclaré les chercheurs. « Par conséquent, il est fortement recommandé d’éviter d’utiliser un compte SAS pour le partage externe. Les erreurs de génération de jetons peuvent facilement passer inaperçues et exposer des données sensibles. »

L’identité est le nouveau point de terminaison : maîtriser la sécurité SaaS moderne

Plongez dans l’avenir de la sécurité SaaS avec Maor Bin, PDG d’Adaptive Shield. Découvrez pourquoi l’identité est le nouveau point final. Sécurisez votre place maintenant.

Ce n’est pas la première fois que des comptes Azure Storage mal configurés apparaissent. En juillet 2022, les Laboratoires JUMPSEC Souligner Scénario dans lequel un acteur malveillant pourrait exploiter ces comptes pour accéder à l’environnement interne d’une organisation.

Ce développement est la dernière faille de sécurité chez Microsoft et survient près de deux semaines après que la société a révélé que des pirates informatiques basés en Chine étaient capables d’infiltrer les systèmes de l’entreprise et de voler une clé de signature très sensible en piratant le compte d’un ingénieur et en accédant potentiellement à un vidage sur incident. d’un système de signature du consommateur.

« L’IA ouvre un énorme potentiel aux entreprises technologiques. Cependant, alors que les data scientists et les ingénieurs se précipitent pour mettre de nouvelles solutions d’IA en production, les quantités massives de données qu’ils traitent nécessitent des contrôles et des mesures de sécurité supplémentaires », a déclaré Ami Luttwak, CTO et co-fondateur de Wiz. dans un rapport.

« Cette technologie émergente nécessite de s’entraîner sur de grands ensembles de données. Alors que de nombreuses équipes de développement doivent gérer d’énormes quantités de données, les partager avec leurs pairs ou collaborer sur des projets open source publics, des cas comme celui de Microsoft sont de plus en plus difficiles à surveiller et à éviter. »

« Évangéliste des médias sociaux. Baconaholic. Lecteur dévoué. Chercheur de Twitter. Pionnier avide du café. »

More Stories

Android Auto et surchauffe du smartphone : les bons réflexes pour éviter les dégâts en été

Google I/O : quelle formule Google AI choisir entre Plus, Pro et Ultra ?

OpenAI prépare un smartphone centré sur l’intelligence artificielle